st Spracherkennung und was kann sie im Gesundheitswesen leisten?

Ob Alexa, Cortana oder Siri: Die Spracherkennung hat seit ein paar Jahren in den Alltag Einzug gehalten. Im beruflichen Bereich profitieren wir von Verfahren der künstlichen Intelligenz, um mit Sprache effizienter zu arbeiten. Erfahren Sie in diesem Artikel alles Wissenswerte zum Thema Spracherkennung und zu ihrem Potenzial im medizinischen Bereich.

Inhaltsverzeichnis

Was ist Spracherkennung?

Wie funktioniert Spracherkennung?

Welche Vorteile bietet die digitale Spracherkennung?

In welchen Bereichen kommt Software zur Spracherkennung zum Einsatz?

Anwendungsbeispiel: Planung und Einführung einer sprachbasierten medizinischen Dokumentation

Geschichte der Spracherkennung

Zukunft: Wohin steuert die Spracherkennung in der Medizin?

Mehrwert von Spracherkennung jetzt nutzen!

Was ist Spracherkennung?

Spracherkennung ist ein Teilgebiet der angewandten Informatik und der Computerlinguistik. Es beschäftigt sich mit der Analyse und Entwicklung von Methoden, um Computern die gesprochene Sprache der automatischen Datenerfassung zugänglich zu machen. Dabei identifiziert ein System gesprochene Wörter und Sätze und wandelt diese in ein Format um, das von Maschinen oder Programmen verstanden werden kann. Doch Spracherkennung ist dabei nicht gleich Spracherkennung. Je nach Fortschrittlichkeit des Systems erkennt es entweder nur einige Schlagwörter und wenige Sätze oder versteht auch einen größeren Wortschatz. Moderne Spracherkennungssysteme nutzen beispielsweise Verfahren der künstlichen Intelligenz, um gesprochene Texte fast fehlerfrei zu erkennen und umsetzen zu können.

Übrigens: Spracherkennung muss von der Stimmerkennung unterschieden werden. Bei letzterem handelt es sich um ein biometrisches Verfahren zur Identifikation einer Person anhand ihrer Stimme.

Wie funktioniert Spracherkennung?

Spracherkennung basiert auf Statistik- und Wahrscheinlichkeitsberechnung und Prinzipien der Linguistik und Phonetik. Die Funktionsweise von Spracherkennung ist wie folgt: Die sprachliche Äußerung wird mit unterschiedlichen, gespeicherten Referenzmustern verglichen, die in kurzen vorherigen Trainingsphasen generiert worden sind. Anhand des Ähnlichkeitsmaßes wird eine Entscheidung getroffen, welche Äußerung vorliegt. Bei diesem Prozess sind verschiedene Analyseverfahren im Einsatz wie Signalanalyse, lexikalische Dekodierung und syntaktische Analyse.

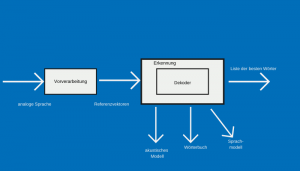

Ein Spracherkennungssystem besteht aus nachfolgenden Komponenten: Einer Vorverarbeitung, die die analogen Sprachsignale in die einzelnen Frequenzen zerlegt. Anschließend findet die tatsächliche Erkennung mittels Wörterbüchern, akustischer Modelle und Sprachmodelle statt.

Schematische Darstellung der Funktionsweise eines Spracherkennungssystems (Quelle)

Die größten Fortschritte in der automatischen Spracherkennung werden durch Entwicklungen im Bereich des maschinellen Lernens und des Deep Learnings erzielt. Da Sprachen ein System aus Mustern und Modellen sind, ist Spracherkennungs-Software für Deep Learning geradezu prädestiniert. Mit je mehr Redewendungen, Sätzen und ganzen Büchern man die Spracherkennung „füttert“, desto besser wird sie. Diese Daten können verwendet werden, um Muster zu erkennen und „vorherzusagen“, welches Wort mit einer gewissen Wahrscheinlichkeit als nächstes zu erwarten ist. Mittlerweile übertrifft KI den Menschen schon bei der Spracherkennung.

Zwei Arten der Spracherkennung lassen sich unterscheiden:

- ✔ Sprecherabhängige Spracherkennung: Hier wird das System vor oder während der Verwendung auf die Besonderheiten der Aussprache des Sprechers trainiert. So kann ein optimales, sprecherabhängiges Resultat erreicht werden (eigenes Vokabular, Abkürzungen usw.). Außerdem kann das System auch auf ein bestimmtes Vokabular trainiert werden. Für ein optimales Ergebnis ist die Interaktion zwischen Nutzer und System entscheidend. Aktuelle Systeme erreichen beim Diktat von Fließtexten Erkennungsquoten von rund 99 Prozent und erfüllen damit für viele Anwendungsbereiche die Praxisanforderungen für Geschäftskorrespondenz, medizinische Dokumentation oder juristische Dokumente.

- ✔ Sprecherunabhängige Spracherkennung: In diesem Fall kann der Benutzer ohne vorherige Lernphase sofort mit der Spracherkennung starten. Allerdings ist hier der Wortschatz limitiert.

Welche Vorteile bietet die digitale Spracherkennung?

Digitale Spracherkennung bietet im Alltag und im beruflichen Einsatz wesentliche Vorteile:

- ✔ Höhere Produktivität und effizientere Workflows: Mitarbeiter, die Texte und Systembefehle diktieren, statt umständlich manuell einzugeben, haben die Hände frei und können ihre Konzentration besser auf ihr Gegenüber richten.

- ✔ Zeit und Kosten werden eingespart: Texte lassen sich mithilfe von Spracherkennung dreimal so schnell erstellen wie durch konventionelles Tippen. Das spart Kosten, zumal auch die Transkriptionstätigkeit durch externe Schreibbüros entfällt.

- ✔ Vielfältige Einsatzmöglichkeiten: Egal, ob es um sprecherunabhängige Spracherkennung für die Kommunikation zwischen Mensch und Maschine (zum Beispiel die Steuerung des Navigationssystems im Auto) oder sprecherabhängige Spracherkennung wie die Erstellung von Geschäftskorrespondenz geht: Software zur Spracherkennung macht den Arbeitsalltag in vielen Branchen einfacher und effizienter.

In welchen Bereichen kommt Software zur Spracherkennung zum Einsatz?

Spracherkennung kommt in den unterschiedlichsten Bereichen zum Einsatz. Hier ein Überblick über aktuelle Anwendungsfelder:

- ✔ Im kommerziellen Kontext zählen zu den häufigsten Anwendungen der Spracherkennung die Sprachsteuerung bei Smartphones, In-Car-Systemen, der Hausautomation, Sprachauswahl in Call-Centern oder in der Sprachsuche.

- ✔ Zudem ist Spracherkennung in jenen Bereichen bedeutsam, bei denen die üblichen Eingabehilfen wie Tastatur und Maus nicht sinnvoll sind, weil die Hände zum Bedienen von Maschinen oder Instrumenten genutzt werden müssen (zum Beispiel Chirurg während der Operation, Personen mit körperlichen Beeinträchtigungen, Bedienung des Navigationssystems während der Autofahrt etc.).

- ✔ Um die Anwendung von Spracherkennung für verschiedene Berufsfelder zu optimieren, werden Versionen mit spezifischen Wortschatzmodellen (Lexika) angeboten:

-

- Geschäftskorrespondenz

- Rechtswissenschaften

- Medizin für die Erstellung von Arztbriefen, Entlassbriefen, OP-Dokumentationen etc.

-

Anwendungsbeispiel: Planung und Einführung einer sprachbasierten medizinischen Dokumentation

Krankenhäuser mit mehreren Standorten und Arztpraxen suchen ständig nach Möglichkeiten, ihre internen und organisationsübergreifenden Prozesse zu verschlanken. Die Spracherkennungslösung von DFC-SYSTEMS ermöglicht eine rasche und personalisierte medizinische Dokumentation direkt in Ihrem KIS oder PVS – standortunabhängig und über verschiedene Programme, Plattformen und Geräte hinweg. Mit ihrer Stimme und spezieller Software erfassen Ärzte Behandlungsverläufe schneller und effizienter.

Bei der Planung und Einführung von digitaler Spracherkennung im Krankenhaus verfolgt DFC-SYSTEMS einen systematischen Ansatz, um das Potenzial der Spracherkennung für die jeweilige Organisation voll auszuschöpfen:

- Analyse des Ist-Zustands der bisherigen Dokumentationsprozesse in den verschiedenen Fachabteilungen.

- Planung eines digitalen, sprachbasierten Dokumentationsprozesses mit den Anwendern (Ärzte, Pflegekräfte, gegebenenfalls Sekretariat) und den IT-Verantwortlichen. Berücksichtigung der unterschiedlichen Dokumentationsformate (medizinische/pflegerische Dokumentation in ePa, Arztbriefschreibung, Entlassbrief, OP-Dokumentation, Gutachten, etc.) und der Diktiergeräte (stationär Diktiergeräte, mobile Diktiergeräte, mobile Devices wie Smartphones oder Tablets)

- Chronologische Einführung des digitalen Dokumentationsprozesses in den Fachabteilungen, beginnend mit den Fachabteilungen, in denen erfahrungsgemäß schnelle, positive Erfahrungen (Reduzierung des zeitlichen Dokumentationsaufwand, Erhöhung der Dokumentationsqualität) erzielt werden können, zum Beispiel in der Chirurgie, Inneren Medizin, Notaufnahme, Orthopädie.

- Intensive Vor-Ort-Begleitung durch den Lösungsanbieter in der Einführungsphase führt zu einer hohen Akzeptanz und schnellen Mehrwerten.

Lesen Sie in unseren Referenzen, wie wir bereits in zahlreichen Krankenhäusern und Facharztpraxen erfolgreich Spracherkennung eingeführt haben und dies nicht nur die Zufriedenheit des medizinischen Personals und der Patienten gesteigert hat, sondern auch die Effizienz.

Die Salus gGmbH mit über 14 Standorten ist eine gemeinnützige Betreibergesellschaft für sozialorientierte Einrichtungen in Sachsen-Anhalt. Erfahren Sie in unseren Referenzen, wie DFC-SYSTEMS mit einer Spracherkennungslösung die vollständige Dokumentation unterstützen und dabei auch mit seinem flexiblen Lizenzmodell punkten konnte, das es dem Träger erlaubt, die Lösung einrichtungsweit kostengünstig zu nutzen. Mehr erfahren!

Geschichte der Spracherkennung

Lange bevor es Computer gab, gab es bereits Versuche, Sprache zu erfassen. Alexander Graham Bell, der Telefon-Erfinder, war an einem System beteiligt, das als Reaktion auf die Laute einer Stimme Rillen in einen Wachszylinder ritzte. Anfang des 20. Jahrhunderts kamen dann die ersten Diktiergeräte auf den Markt, die Stimme auf verschiedenen Medien wie Wachs, Kunststoff und später dann auch auf Magnetbändern aufzeichnen konnten. Mit diesen Systemen konnte Sprache allerdings nur aufgezeichnet und wiedergegeben werden.

Die Forschung an Spracherkennungssystemen startete in den 1960er Jahren, jedoch ohne wirkliche Erfolge. Die von privaten Unternehmen programmierten Systeme ermöglichten im Labor die Erkennung von einigen Dutzend Einzelwörtern. Dies lag einerseits an dem begrenzten Know-how auf diesem noch jungen Forschungsgebiet, andererseits waren die Rechner damals bei weitem noch nicht so leistungsfähig wie heute.

In den 1970er Jahren konnte das Projekt Harpy Alltagssprache verarbeiten und einzelne Wörter auswählen, war allerdings auf einen Wortschatz von zirka 1.000 Wörtern begrenzt. Der Durchbruch gelang in den 1980er Jahren, als Spracherkennungssysteme auf dem Markt auftauchten, die auf Basis mathematischer Modelle wie dem Hidden-Markov-Modell funktionierten. Dieses greift auf Statistiken zurück, um Worte, Sätze und Ausdrücke zu prognostizieren. Damit konnten nicht nur einzelne Wörter identifiziert werden, sondern die Spracherkennung war in der Lage, sinnvolle Sätze zu generieren. Um einen sprachlich korrekten Satz zu erzeugen, muss die Spracherkennung zwischen verschiedenen gleichklingenden Wörtern und der unterschiedlichen Bedeutung unterscheiden können.

Zukunft: Wohin steuert die Spracherkennung in der Medizin?

Die Zukunft der Spracherkennung liegt in der sprachbasierten Mensch-Maschine-Kommunikation, zum Beispiel mittels Voice-Assistenten wie Alexa und Co. Immer mehr Geräte werden mit Sprache gesteuert. Aber auch im Bereich des Natural Language Processing (NLP), also nicht nur in der Spracherkennung, sondern im Sprachverstehen, tut sich einiges.

Möglichkeiten ergeben sich hier im medizinischen Bereich beispielsweise bei der Optimierung der Spracherkennung für eine dialogbasierte Sprachsteuerung. Die Software wird sozusagen responsiv und Befehle können durch Nachfragen konkretisiert werden. Zudem muss die Sprachsteuerung intuitiver werden und unterschiedliche Dialekte und Sprachherkünfte unterstützen. Im Bereich der semantischen Spracherkennung arbeitet man daran, die strukturierte Befundung in der Radiologie mit dem Einsatz von natürlicher Sprache in einem audiovisuellen Dialog verwirklichen zu können.

Außerdem kann NLP das Potenzial unstrukturierter Daten nutzen und wichtige medizinische Daten aus unstrukturiert vorliegenden Texten identifizieren. Man geht davon aus, dass 80 Prozent der Informationen über Patienten in unstrukturierter Form vorliegen (zum Beispiel in Arztbriefen, klinischen Befunden, Radiologieberichten etc.). NLP unterstützt datengesteuerte Entscheidungsfindungen im medizinischen Bereich, indem es den strukturierten Zugriff auf den Inhalt dieser Dokumente erlaubt. Zudem können klinische Informationen aus mehreren Berichten extrahiert und für den Arzt zusammengefasst werden, so dass dieser einen besseren Überblick über die Krankheitsgeschichte seines Patienten erhält. Spracherkennung erleichtert dem medizinischen Personal, das auf klinische Daten angewiesen ist, in vielerlei Hinsicht die tägliche Arbeit.

Mehrwert von Spracherkennung jetzt nutzen!

Sie diktieren Patienteninformationen noch auf ein Band oder tippen selbst und lassen dieses durch ein Sekretariat transkribieren? Dann nutzen Sie jetzt den Mehrwert von Spracherkennung auch in Ihrer Einrichtung. Dank Spracherkennung erledigen und validieren Ärzte ihre medizinische Dokumentation in nur einem Arbeitsgang um ein Vielfaches schneller als bisher, Workflows werden optimiert und Ressourcen effizient eingesetzt. Diese Zeitersparnis kommt letztlich dem medizinischen Personal und den Patienten zugute.

Bildnachweis: Titelbild: Westend61/gettyimages, Bild 1: © DFC-SYSTEMS, Bild 2: © DFC-SYSTEMS.